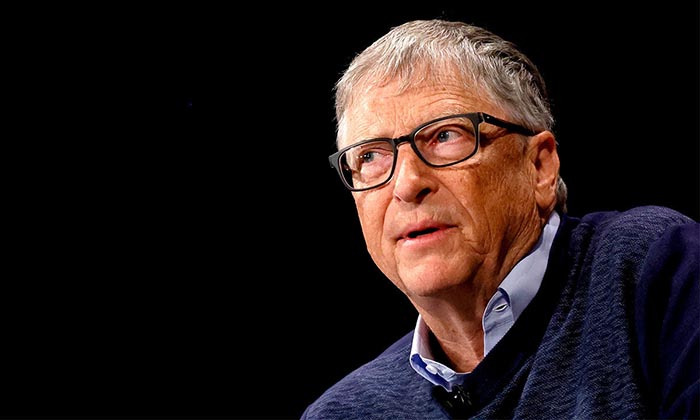

Tỷ phú Bill Gates đã đưa ra những phát ngôn công khai đầu tiên để đáp lại bức thư ngỏ được đồng ký tên bởi tỷ phú Elon Musk cùng hơn 13.000 chuyên gia. Bức thư kêu gọi các phòng thí nghiệm trí tuệ nhân tạo “ngay lập tức tạm dừng” đào tạo các hệ thống mạnh hơn Chat GPT-4 trong ít nhất 6 tháng.

Ông Gates – người đồng sáng lập Microsoft – nói với Reuters trong một cuộc phỏng vấn rằng việc tạm dừng phát triển trí tuệ nhân tạo (AI) sẽ không “giải quyết được những thách thức” phía trước, rằng việc đó sẽ khó có thể được thực hiện trên quy mô toàn cầu và rằng lý do căn bản để làm điều đó là không rõ ràng.

Microsoft đang đi đầu trong cuộc đua AI, đã đầu tư hàng tỷ đô-la vào OpenAI – công ty tạo ra ChatGPT và bản cập nhật mới nhất GPT-4.

Vào tuần trước, ông Musk – giám đốc điều hành của Twitter và Tesla – đã ký tên vào một lá thư do tổ chức phi lợi nhuận Future of Life Institute đưa ra. Lá thư cảnh báo rằng các phòng thí nghiệm AI đang bị cuốn vào một “cuộc chạy đua ngoài tầm kiểm soát”; việc họ phát triển “những bộ óc kỹ thuật số mạnh mẽ hơn bao giờ hết” – những thứ mà con người không thể hiểu đầy đủ và không thể kiểm soát hoàn toàn – sẽ gây ra hậu quả thảm khốc.

Lá thư nhận được hơn 1.000 chữ ký vào tuần trước; hiện nay, con số này đã tăng lên hơn 13.000. Trong những người ký tên có ông Steve Wozniak – đồng sáng lập Apple, ông Emad Mostaque – người sáng lập và giám đốc điều hành của Stability AI, các kỹ sư từ Meta và Google, cùng nhiều chuyên gia khác. Họ đã kêu gọi tất cả các phòng thí nghiệm AI “tạm dừng ngay lập tức” việc đào tạo các hệ thống mạnh hơn Chat GPT-4 trong ít nhất 6 tháng.

Bức thư không kêu gọi ngừng phát triển AI nói chung, mà chỉ kêu gọi ngừng phát triển các hệ thống tiên tiến nhất. Các chuyên gia mô tả hành động này “chỉ đơn thuần là một bước lùi khỏi cuộc đua nguy hiểm – cuộc đua không thể đoán trước của các mô hình hộp đen (black-box model)…”.

Tỷ phú Bill Gates, trong cuộc phỏng vấn với Reuters, đã dội một gáo nước lạnh vào ý tưởng tạm dừng phát triển AI được nêu trong bức thư. Ông đề xuất một hướng hành động khác.

“Tôi không nghĩ việc yêu cầu một nhóm cụ thể nào đó tạm dừng sẽ giải quyết được các thách thức”, ông Gates nói. “Rõ ràng, chúng [AI] mang đến những lợi ích to lớn … điều chúng ta cần làm là xác định các khía cạnh rắc rối”.

Ông Gates cũng chỉ trích các tiêu chí thực thi mơ hồ mà bức thư đề ra.

“Tôi thực sự không hiểu họ đang nói ai nên dừng lại, và liệu mọi quốc gia trên thế giới có đồng ý dừng lại không, và tại sao phải dừng lại”, Bill Gates nói với Reuters. “Có rất nhiều ý kiến khác nhau trong lĩnh vực này”.

Tuy nhiên, hôm 21/3, người đồng sáng lập Microsoft đã đăng trên trang blog cá nhân GatesNotes rằng “có khả năng AI sẽ vượt khỏi tầm kiểm soát” và sẽ coi con người là mối đe dọa.

Ông cũng thừa nhận rằng trong tương lai, các AI siêu thông minh hoặc AI “mạnh” (strong AI) có thể có khả năng tự đặt ra các mục tiêu đi ngược lại với lợi ích của nhân loại.

Tác động ‘thảm khốc’ đối với xã hội

Trong bức thư ngỏ của Future of Life Institute, các chuyên gia cảnh báo rằng các hệ thống AI có trí thông minh có thể cạnh tranh với con người sẽ gây ra “những rủi ro sâu sắc cho xã hội và nhân loại”; do đó, chúng ta cần lên kế hoạch quản lý cẩn thận để tránh những tác động “thảm khốc” có thể xảy ra.

Các chuyên gia viết: “Chúng ta đã thành công trong việc tạo ra các hệ thống AI mạnh mẽ, giờ đây, chúng ta có thể tận hưởng một ‘mùa hè AI’ – quãng thời gian chúng ta gặt hái thành quả, điều chỉnh các hệ thống sao cho chúng mang lại lợi ích cho tất cả mọi người và sao cho xã hội có cơ hội thích nghi”.

“Con người đã tạm dừng [phát triển] các công nghệ khác – những thứ có nguy cơ gây ra hậu quả thảm khốc cho xã hội. Chúng ta có thể làm như vậy ở đây [với AI]. Hãy tận hưởng một mùa hè AI dài, đừng vội vàng không chuẩn bị gì mà bước sang mùa thu”.

Bức thư kêu gọi tất cả các phòng thí nghiệm AI tạm dừng đào tạo các hệ thống AI mạnh hơn GPT-4 trong tối thiểu 6 tháng, hoặc chính phủ cần ban hành một lệnh cấm tạm thời việc đào tạo như vậy nếu các phòng thí nghiệm AI không tự tạm dừng.

Theo bức thư, trong thời gian tạm dừng, các phòng thí nghiệm AI và các chuyên gia độc lập nên sử dụng khoảng thời gian đó để tạo ra và triển khai một bộ giao thức an toàn dùng chung cho thiết kế và phát triển AI tiên tiến; bộ giao thức này cần được “kiểm tra nghiêm ngặt” và được giám sát bởi các chuyên gia bên thứ ba độc lập.

Ông Eliezer Yudkowsky, nhà nghiên cứu hàng đầu trong lĩnh vực này, cho biết ông tin rằng các hệ thống siêu thông minh sẽ quét sạch nền văn minh loài người:

“Chúng ta chưa sẵn sàng. Chúng ta đang không đi đúng hướng để có thể trở nên sẵn sàng hơn trong tương lai gần. Nếu chúng ta tiếp tục đi như thế này thì tất cả mọi người sẽ chết, kể cả những đứa trẻ – những người không chọn điều này và không làm gì sai”.

Xuân Hoa tổng hợp